Где-то с марта нагрузка на сервер сильно возросла, что было неестественно и аномально для размещенных на сервере проектов. Проекты можно разделить условно на две группы:

- Группа А — Блог; OpenProvinceMap (ОПМ), включая сервер тайлов (внутриигровой аналог яндекс.карт/openstreetmap по игре MTA Province); Служба по мониторингу онлайна «ТБРУ»

- Группа Б — «Первая Провинциаяльная Википедия»/Провинцпедия — внутриигровой аналог википедии — формат малоинтересен нынешней ЦА игры…

В середине марта подозрения пали на первую группу, в частности на ОПМ — так бывает, выросла посещаемость = выросла нагрузка, «Провинцпедия» даже не рассматривалась ввиду того, что данный формат малоинтересен игрокам и её помещаемость не могла настолько вырости…

Но… Статистика посещаемости на ОПМ ничем не отличалась от обычной. Может вина в тайлах? Тоже мимо, внешние запросы к тайлам также держались на обычном уровне… Не найдя поверхностно причины, я видел решение только в расширении сервера, но апгрейд и решение проблемы были отложены на месяц (и, в какой-то мере, слава богу)

Месяц спустя виновные найдены…

Лишь месяц спутя — в начале апреля — я случайно обнаружил аномалию в статистике посещаемости той самой «википедии»: просмотров было немногим больше, чем у опм, доля новых посетителей ежедневно составляла (95-99)% — максимально подозрительные циры

При изучении логов запросов за 3 апреля было обнаружено:

- 290к запросов к сайту за сутки

- 15,7 ГБ исходящего трафика

Для небольшого (и малоинтересного для ЦА игры) сайта это явный перебор…

При детальном анализе логов выявлено, что 270к из 290к запросов — это боты и нейросети, то есть 93% трафика сайта — это боты и ИИ

Из 15,7 гигабайт исходящего трафика ботам и нейросетям отдано 14,6 — треш. По другому описать не могу…

Причем почти 11,6 из них отданы для ИИ от ████ (четыре буквы со скрина ниже)

В запросах бот ████ использует user-agent meta-externalagent/1.1 (+https://developers.facebook.com/docs/sharing/webmasters/crawler) или meta-externalagent/1.1

████ ежечасно по 10 тысяч раз качает контент, который не меняется уже несколько лет, при этом сильно (и бессмысленно) нагружая сервер, — и все это ради обучения собственной (а возможно не только собстенной) нейросети:

Для сравнения: проекты из группы А суммарно за 3 апреля собрали всего 73к запросов (1,7 ГБ)…

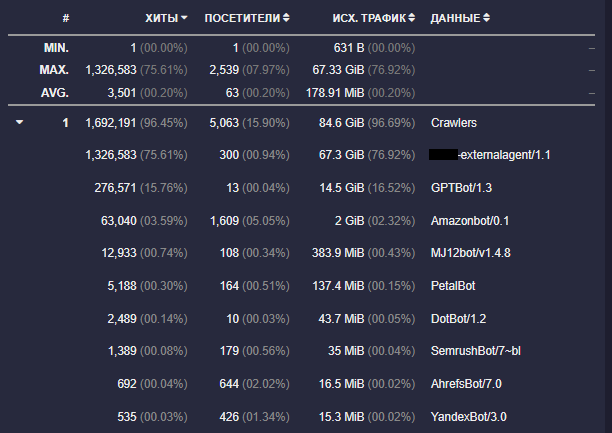

Анализ логов за 30 марта — 03 апреля

За 5 дней к «википедии» было совершено 1,7 МИЛЛИОНА запросов… Исходящий трафик 87 с половиной гигабайт…

В лидерах по потреблению, конечно же, ████ — 1,3кк запросов на 67 гигабайт

Доля реального трафика, дай бог, составит хотя бы 3%

Вот такая вот новая реальность, теория мертвого интернета превратилась в аксиому…

21-й век. Итоги.

И самый главный абсурд сей ситуации…

Игровой аналог википедии содержит всего 154 статьи, посвященных вымышленному миру игры…

154 статьи. Не 154 тысячи, не 154 миллиона, а просто 154… То есть за 5 дней каждая статья была скачала нейросетью ████ для последующего обучения почти 9 тысяч раз — это вот для чего это все? Это примерно 75 раз в час на одну статью… Вы там, в ████, совсем, или как???? Вы считаете, что я статьи каждую минуту редактирую или как????

Если экстраполировать на месяц — ████, вероятно, выкачала 400 гигабайт данных для обучения, GPT — 87 гигабайт. И это при том, что там всего 154 небольшие статьи….. Всего же ботам за месяц могло быть отдано полтерабайта трафика, в то время как на долю настоящих людей, скорее всего, пришлось лишь 15 ГБ за месяц…